2025年11月26日水曜日のらニュースでございます。

仲間内の「遊び」で作られた画像だった

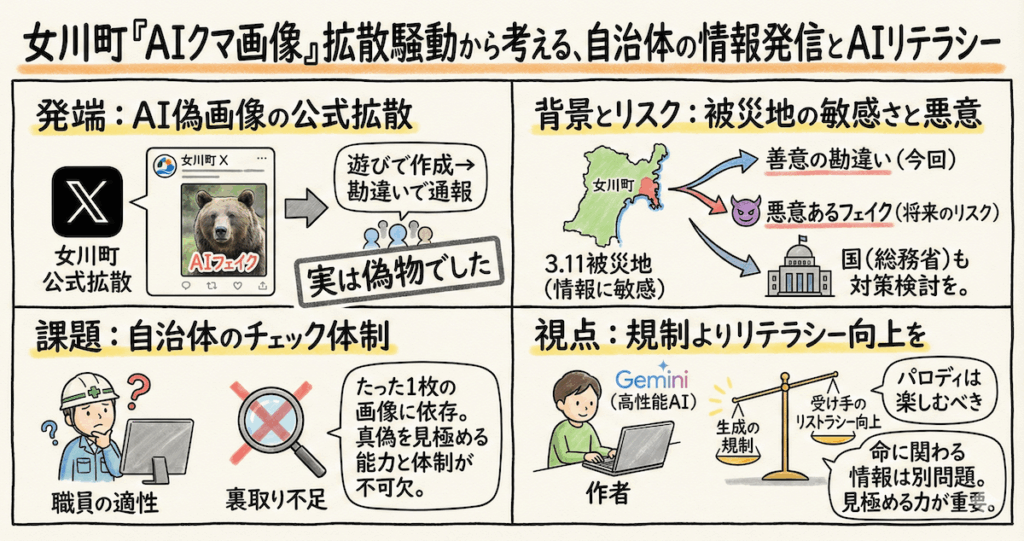

さて今日は、宮城県の女川市でのニュースをお伝えします。女川市が公式のXで、町内で確認されたクマの画像を拡散していましたが、どうやらフェイク画像だったという発表がありました。

これは昨日の19時ごろ、町内のとある地区で目撃されたクマの様子だということで、かなり大きなクマの写真が公開されたのですが、実はそれはAIで作られたフェイク画像とのことです。

この画像は、グループ内で遊びで作られたもので、その中の方が本物だと勘違いして情報を提供した流れだったようです。町側もその情報を拡散してしまいましたが、最終的にはフェイクだと制作者から連絡があったという形になっています。

「写真1枚」だけでなく、複合的な情報収集の必要性

これには多くの問題が考えられると思いますが、一つ目は、自治体側のチェック機能です。最近の技術の中で、生成AIかどうかを見極める能力が自治体にあるかどうかはわからない部分があります。やはり裏取りをしていかなければならないという点が最大の問題ではないでしょうか。

AIによる画像を信じてしまったことが問題なのではなく、その写真1枚からすべてを把握したことに問題があります。例えばその画像が嘘だとしても、他に目撃情報があった場合はそれを総合して出すことができれば良いのですが、1枚の画像だけに頼るのは、どうしても不十分と感じます。

それでも実際、クマが出てくる可能性はあるため、町としては警告しているわけですが、裏取り能力が求められることは非常に重要です。

もし「悪意を持った情報提供」だったら…

特に女川は、東日本大震災の被災地であり、自然災害についての情報発信には敏感に対応している自治体であると思います。そうした自治体でも、今回のような事態が起きてしまったことは、今後のリスクを考えると非常に高い問題です。

今回フェイク画像を信じた人による情報提供でしたが、時には悪意を持って作成された情報が流れる可能性もあります。

そうした事態も十分に想定できる場合を考えると、今回の教訓をどう活かすかはそれぞれの自治体だけでなく、国、特に総務省にも責任があります。生成AIの画像がフェイク画像とならないようにするために、しっかりと考慮すべき立場だと思います。

「フェイクそのものの規制」には反対

この数日、私はGoogleのGeminiというサービスの有料版を使って画像生成機能「Nano Banana Pro」を試しています。非常に精度の高い画像生成ができるという噂を聞いて導入したところ、実際のところ数日間取り扱う内容も非常に高い精度で生成されています。

ただ、その一方でフェイクを作ることそのものには、制限を加えられるべきではないと思っています。あくまで受け手のリテラシーを向上させ、冗談やパロディーとして楽しめる部分を潰さないようにしたいと考えています。

当然ながら、今回のように命に直結する危険がある情報では問題があると思いますが、たとえば明らかにフェイクだと理解できるようなものであれば、それは問題ないのではと考えています。それではまた次回お会いしましょう。

(以上はコラムニスト・城戸譲が、ポッドキャスト「のらニュース」などで話した内容を、AI文字起こし・要約によってブログ記事化したものです。公開時点で最新情報ではない可能性があるため、その点はご了承ください)